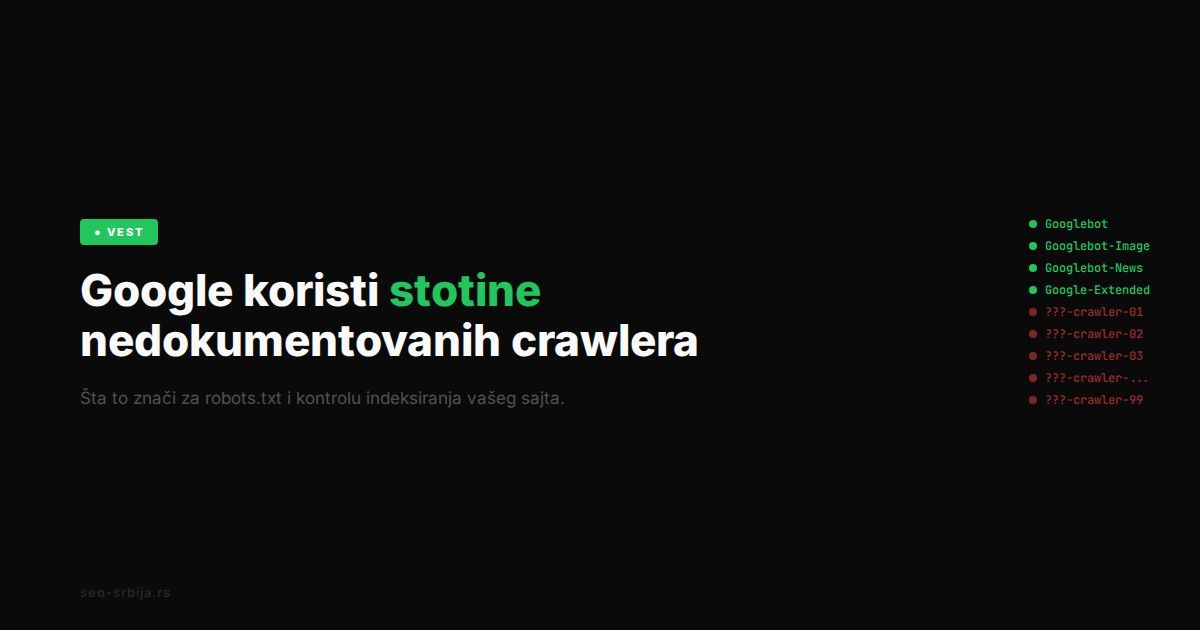

Google najavio stotine nedokumentovanih crawlera: šta to znači za robots.txt

Google je potvrdio da koristi stotine crawlera koji nisu u dokumentaciji. Kako to utiče na kontrolu indeksiranja vašeg sajta.

U martu 2026. Google je zvanično potvrdio ono što su SEO stručnjaci dugo sumnjali: kompanija koristi stotine crawlera koji nisu navedeni u zvaničnoj dokumentaciji. Ova informacija menja način na koji razmišljamo o robots.txt i kontroli pristupa sajtu.

Šta je Google rekao

Search Engine Journal je objavio da je Google u odgovoru na direktno pitanje potvrdio da pored poznatih crawlera (Googlebot, Googlebot-Image, Googlebot-News, itd.) koristi i stotine drugih koji nemaju javnu dokumentaciju.

Ovi crawleri se koriste za različite svrhe:

- Testiranje novih funkcionalnosti pretrage

- Prikupljanje podataka za AI treniranje

- Provera kvaliteta i spam detekcija

- Specifični projekti unutar Google-a

Zašto je ovo bitno za SEO

Robots.txt možda ne blokira sve

Robots.txt radi na principu user-agent identifikacije. Kad napišeš:

User-agent: Googlebot

Disallow: /privatno/…blokiraš samo crawler koji se identifikuje kao „Googlebot”. Ako nedokumentovani crawler koristi drugi user-agent: tvoja pravila ga ne pokrivaju.

Do sada je preporuka bila da blokiraš Googlebot i da je to dovoljno za Google. Sada znamo da to možda nije ceo priča.

Wildcard pravila nisu potpuno rešenje

Možeš napisati:

User-agent: *

Disallow: /privatno/Ovo blokira SVE crawlere koji poštuju robots.txt. Ali robots.txt je preporuka, ne zakon. Crawleri nisu obavezni da ga poštuju.

Šta ovo znači u praksi

Za većinu sajtova: ništa drastično

Ako imaš običan sajt sa javnim sadržajem i nemaš razlog da skrivaš stranice od Google-a: ova vest te ne pogađa direktno. Google i dalje indeksira tvoj sajt kroz standardnog Googlebot-a.

Za sajtove sa osetljivim sadržajem

Ako koristiš robots.txt da sprečiš indeksiranje internih stranica, admin panela ili staging okruženja: razmisli o jačim merama:

Noindex tag je pouzdaniji od robots.txt. Tag <meta name="robots" content="noindex"> u HTML-u govori Google-u da ne prikazuje stranicu u rezultatima, bez obzira na to koji crawler je pronašao stranicu.

Autentifikacija (login) je najpouzdanija. Ako stranica zahteva korisničko ime i lozinku, nijedan crawler joj ne može pristupiti.

HTTP autentifikacija (.htpasswd) na staging sajtovima je jednostavna i efektivna.

Za sajt publishere zabrinute oko AI

Ovo je posebno relevantno za izdavače koji ne žele da Google koristi njihov sadržaj za AI treniranje. Dosadašnje blokiranje Google-Extended user-agenta (namenjenog za AI prikupljanje) možda ne pokriva sve crawlere koje Google koristi za ovu svrhu.

Preporuke

1. Koristi noindex umesto robots.txt Disallow

Za stranice koje ne želiš u Google indeksu, noindex je pouzdaniji:

<meta name="robots" content="noindex, nofollow">Ili kao HTTP header:

X-Robots-Tag: noindex2. Ne oslanjaj se samo na robots.txt za bezbednost

Robots.txt nikad nije bio bezbednosni mehanizam. Sada je to još jasnije. Za privatne stranice koristi autentifikaciju.

3. Prati server logove

Jedini način da vidiš koji crawleri pristupaju tvom sajtu je analiza server logova. Traži user-agente koje ne prepoznaješ i IP adrese iz Google-ovih poznatih rangova.

grep "bot\|crawler\|spider" access.log | awk '{print $1, $14}' | sort | uniq -c | sort -rn4. Ažuriraj robots.txt

Ako nisi ažurirao robots.txt dugo, uradi to:

User-agent: *

Disallow: /admin/

Disallow: /staging/

Disallow: /privatno/

User-agent: Google-Extended

Disallow: /

Sitemap: https://tvoj-sajt.rs/sitemap.xmlAli zapamti: ovo je prva linija odbrane, ne jedina.

Širi kontekst: borba za kontrolu sadržaja

Ova vest dolazi u kontekstu rastućeg tenzije između izdavača sadržaja i AI kompanija. SerpApi je upravo tužen od Reddit-a za scraping, Amazon je dobio sudsku zabranu protiv Perplexity-jevog Comet bot-a, i sve više sajtova traži bolju kontrolu nad tim ko pristupa njihovom sadržaju i za šta.

Google-ovo priznanje stotina nedokumentovanih crawlera dodaje ulje na vatru u ovoj debati.

Zaključak

Google koristi više crawlera nego što dokumentuje. Za većinu sajtova ovo ne menja svakodnevni SEO rad. Ali ako se oslonjaš na robots.txt za kontrolu indeksiranja, vreme je da dodaš noindex tagove kao drugi sloj zaštite.

I generalno: tretriraj robots.txt kao saobraćajni znak, ne kao zid. Znak kaže „ne ulazi”, ali nema fizičku barijeru. Za pravu zaštitu, treba ti kapija sa bravom.